Por Alejandro Batista

Los sistemas, plataformas y aplicaciones potenciadas con tecnología de Inteligencia Artificial han sido una de las estrellas del año 2022. Entre ellas una de las opciones que ha acaparado y lo sigue siendo, todas las miradas por la espectacularidad y la facilidad para su uso es, sin dudas, ChatGPT de la empresa OpenIA. Una organización surgida en el año 2015 como un emprendimiento sin fines de lucro, aunque a la luz de los acontecimientos es algo que podría cambiar próximamente.

¿Qué es ChatGPT?

Se trata de un ChatBot conversacional lanzado el 30 de noviembre de 2022, que funciona utilizando Procesamiento de Lenguaje Natural (o NLP) y lo aplica a un sinnúmero de consultas que quieran hacer los usuarios que prueban la versión—por el momento gratuita—del Bot que se puede acceder en: https://chat.openai.com/chat

Desde entonces prácticamente no ha quedado ámbito, profesión o tarea en la que las personas no hayan utilizado ChatGPT desde su presentación. Se le han encargado todo tipo de tareas, crear sonetos, escribir comentarios, elaborar contenido para redes sociales, generar y corregir código informático, preguntarle sobre el futuro de los abogados con la inteligencia artificial, que explique cómo es su propio funcionamiento, etc… No hay límite para las opciones, solo la imaginación de cada persona.

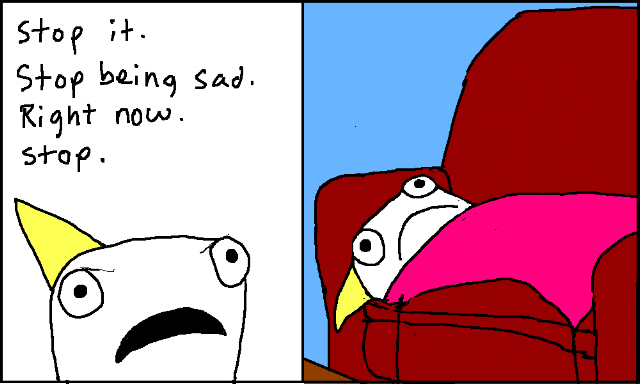

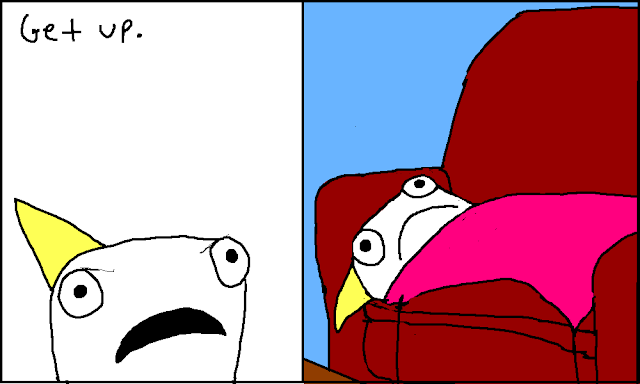

Desde luego esto ha despertado un intenso debate que suele discurrir en dos líneas que se entrecruzan, por una parte, si esta herramienta puede llegar a reemplazar o hacer obsoletas ciertas tareas e incluso profesiones, y hasta qué punto son efectivas y fiables las respuestas que se obtienen de su uso.

Imagen 1

Este debate tiene particular intensidad en el ámbito educativo y académico. En ese sentido, tenemos ejemplos de todo tipo. Desde la decisión de algunas universidades de prohibir su uso y de volver a evaluaciones con papel y lápiz, pasando por editoriales que anunciaron la posibilidad de admitir trabajo científicos que acrediten como “co-autor” a sistemas de Inteligencia Artificial, e incluso algunos casos en los que se puso a prueba a ChatGPT con exámenes reales o certificaciones profesionales.

La IA como Co-autor

Fue la Editorial Springer Nature quien comunicó recientemente su decisión de aceptar papers en lo que haya participado algún sistema de inteligencia artificial en su redacción, aunque juntamente con una persona humana y siempre que se lo aclare expresamente al establecer que: “…los autores podrán utilizar herramientas de IA para generar ideas o ayudar a escribir sus textos, siempre y cuando acrediten adecuadamente este tipo de colaboración en el trabajo publicado”.

Imagen 2

Esa posibilidad de co-autoría ya ha sido utilizada como se puede apreciar en el artículo presentado por un grupo de científicos pertenecientes al ámbito de la salud en la plataforma que recopila preprints Medrxiv.

En la misma línea se ubica la Plataforma de blogging Medium, que ha dicho que aceptará este tipo de publicaciones en co-autoría y siempre que esté debidamente etiquetado como tal, y en caso de omisión cuando se detecte que un texto ha sido producido por una Inteligencia Artificial, esas publicaciones no serán distribuidas por la plataforma .

También en Política

Se ha dicho que se predica con el ejemplo y eso debe haber pensado Jake Auchincloss congresista demócrata que “…se apoyó en ChatGPT para escribir un texto sobre un proyecto de ley que promueve la construcción de un centro de investigación de IA”, continuando otras experiencias del estilo donde es la propia Inteligencia Artificias quien redacta proyectos de Ley para regular a la Inteligencia Artificial.

Imagen 3

¿Aprueba o no aprueba? ¿Qué opinan? Esperamos sus comentarios, reflexiones y aportes sobre el tema.